Linutop, c’est une entreprise qui propose un mini ordinateur avec une Xubuntu allegée. Ce genre de boitiers est dédié à des accès internet public, du genre espace public numérique, hôtel, ou encor des écoles.

La machine en elle même est assez petite, peu gourmande. J’ai été contacté pour donner mon impression sur la dernière version de la Linutop. Après avoir récupéré l’image ISO de démonstration, j’ai créé un machine virtuelle VirtualBox avec 2 Go de mémoire, sachant que la linutop dernière version en « haut de gamme » propose au maximum 2 Go de mémoire vive et de 2 Go d’espace de stockage flash.

Basée sur la Xubuntu 12.04, elle propose un mode « kiosque internet », des outils comme LibreOffice ou encore VLC. Bref, le minimum indispensable dans un espace public numérique ou en tant que borne internet classique.

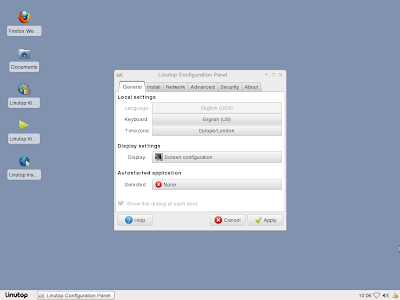

Le gros hic de la version de démonstration : elle est en anglais, configurée pour le clavier anglais et le fuseau horaire de Londres. Et l’ensemble de la logithèque est en anglais.

Seule l’installation en dur permet de contourner la barrière de la langue. Au premier démarrage de l’OS installé, on peut enfin contourner la barrière de la langue.

Continuer la lecture de « Linutop, une bonne idée mais difficile à mettre en oeuvre ? »