Et oui, déjà le 13ième épisode de la série. Ne soyons pas superstitieux, ça porte malheur. Enfin, dixit Pierre Desproges.

Hier, 5 juin 2013, les vieux de la vieille ont pu fêter les 11 ans de la Suite Mozilla 1.0. Oui, je parle bien du lointain ancêtre de Mozilla Firefox / Mozilla Thunderbird.

Après plus de 4 ans de travail, suite à la libération du code source de Netscape Communicator 5 (du moins, sa version pré-alpha) le 31 mars 1998, et un redémarrage à zéro à la fin de la même année, la première version de la Suite Mozilla sort.

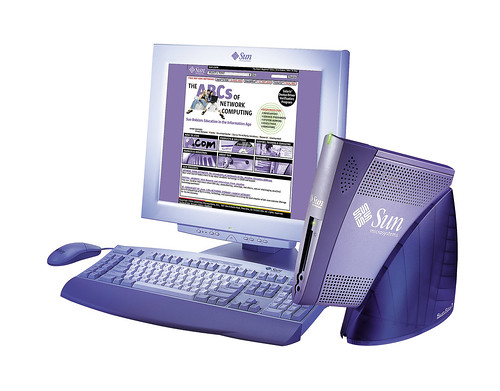

Pour mémoire, en 2002, la machine de « bonne gamme » était du genre Pentium III (ou équivalent AMD) à 1 Ghz, 128 à 256 Mo de mémoire vive, un disque d’environ 50 à 80 Go. Cf ce support de cours que j’ai pu trouvé via mon ami Google.

Il faut se souvenir que 2002, c’est la fin de la première guerre des navigateurs, qui laisse l’ancien leader Netscape exsangue. En juin 2002, selon les archives de OneStat, la situation est claire : Internet Explorer 4 à 6 : 95% des navigateurs sur la toile. Autant dire que la sortie de la suite Mozilla 1.0 était plus une folie pour nombre de personnes qu’un espoir de rééquilibrer la balance.

Pour les personnes n’ayant pas connu la glorieuse époque de la suite Mozilla, j’ai fait une petite vidéo pour présenter l’engin de l’époque. C’était vraiment une usine à gaz à l’époque, surtout qu’il faut se souvenir que le top du top en France, c’était la connexion en ADSL 512K…

J’ai utilisé une Red Hat Linux 7.3, sorti en mai 2002 avec les paquets RPMs disponible sur le serveur FTP de la Fondation Mozilla.

Bon, ce n’était pas super stable, une sacrée usine à gaz… Cela fait étrange de voir le chemin parcouru depuis !